Azure Percept DKを触ってみる③ - サンプルモデルデプロイ編

はじめに

前記事でカメラモジュールの動作確認が完了しました。 今回はAzure Percept Studioで事前に学習が完了しているサンプルモデルをAzure Percept DKにデプロイしてみようと思います。

こちらを参考に進めていきます。

サンプルモデルをデプロイする

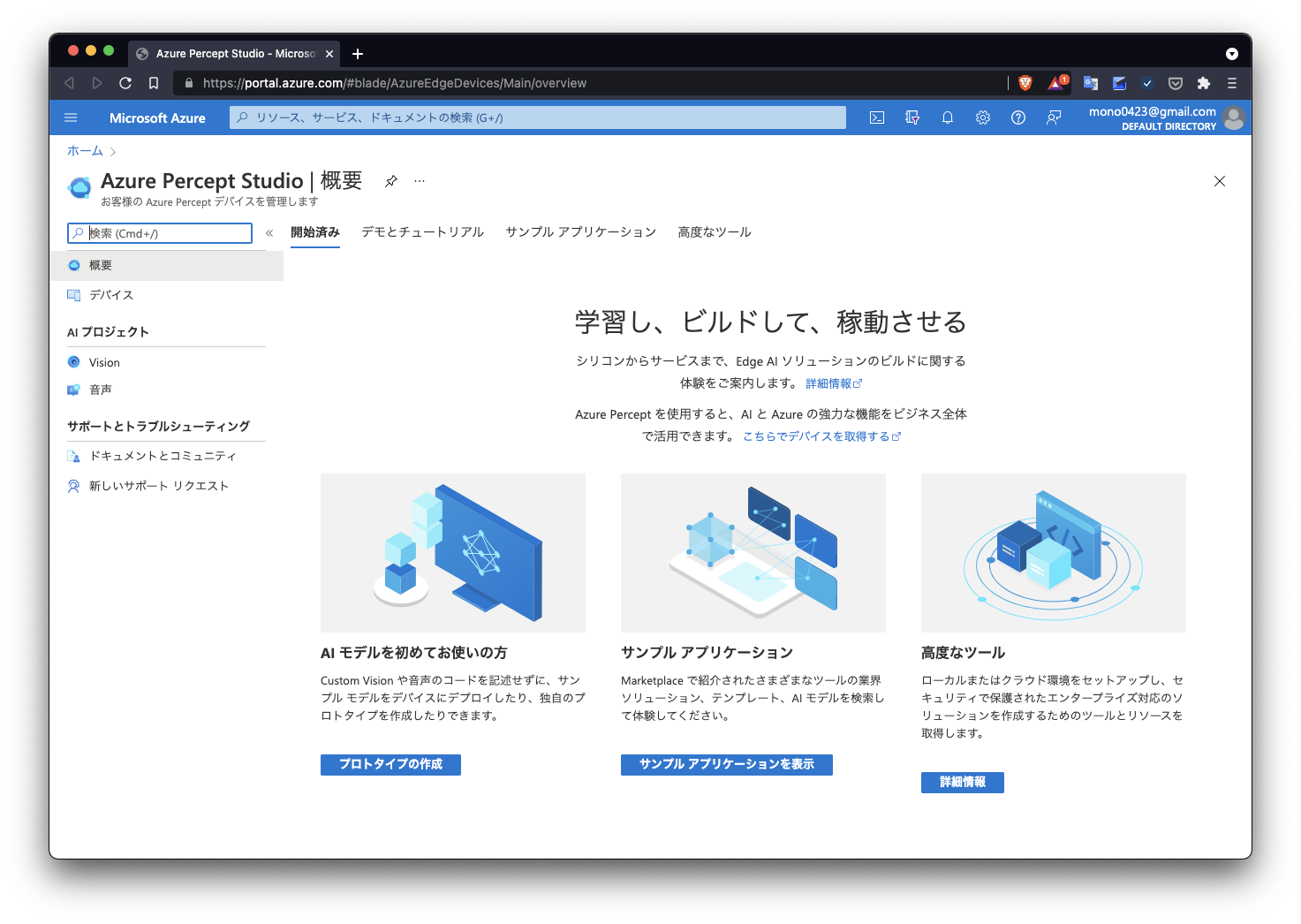

Azure Percept Studioを開き、サイドメニューのデバイスを選択します。

https://portal.azure.com/#blade/AzureEdgeDevices/Main/overview

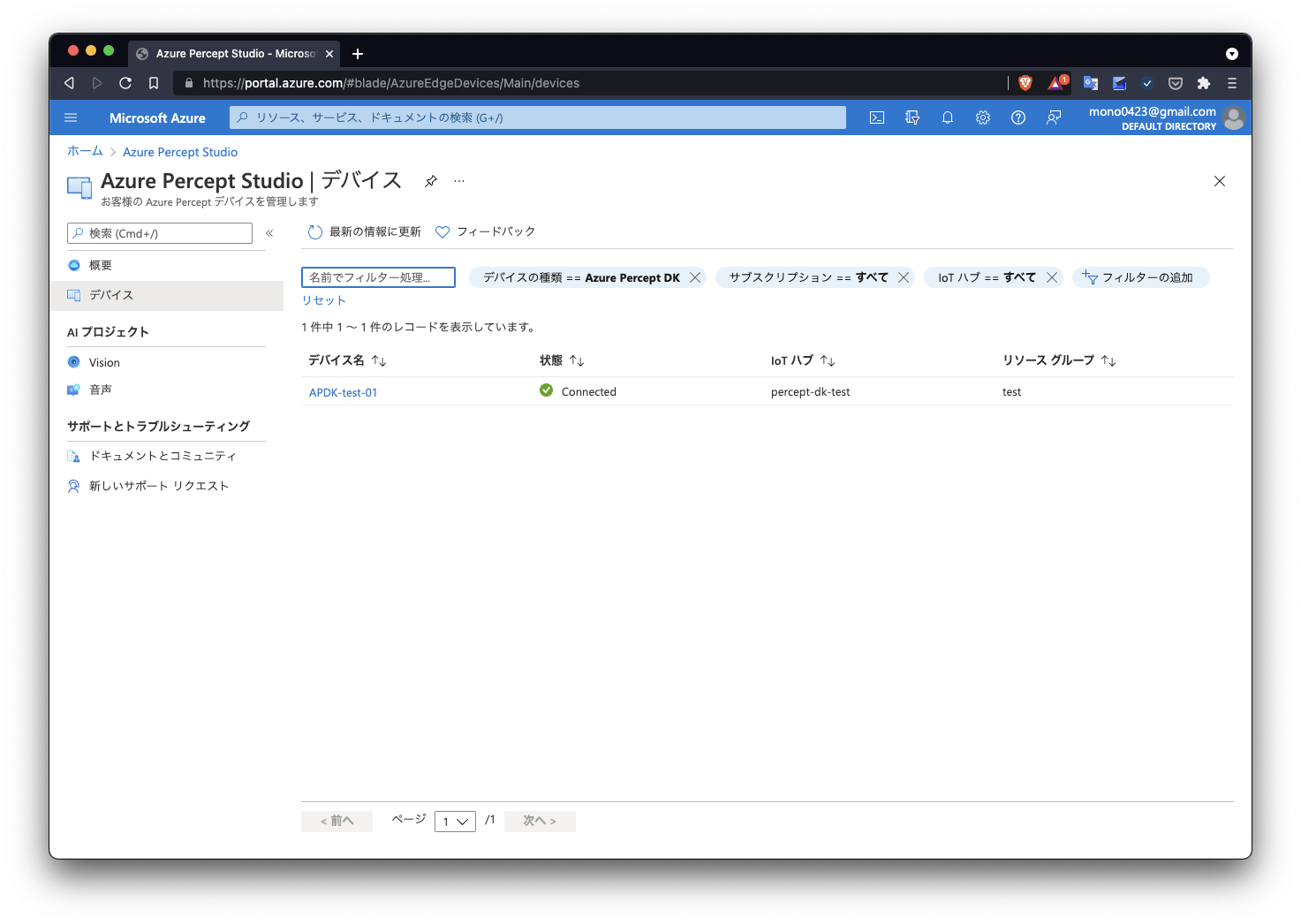

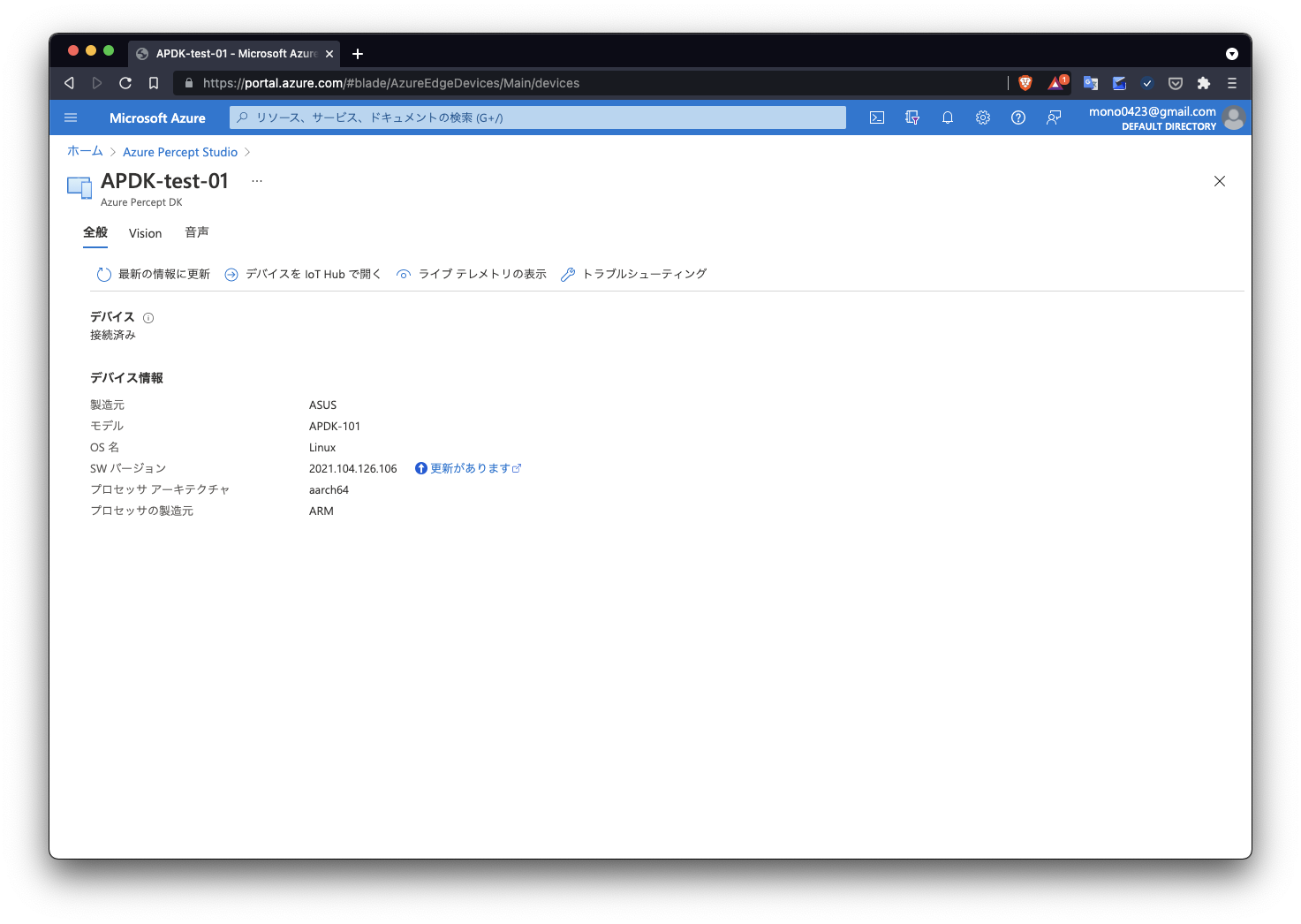

セットアップしたデバイスを選択します。

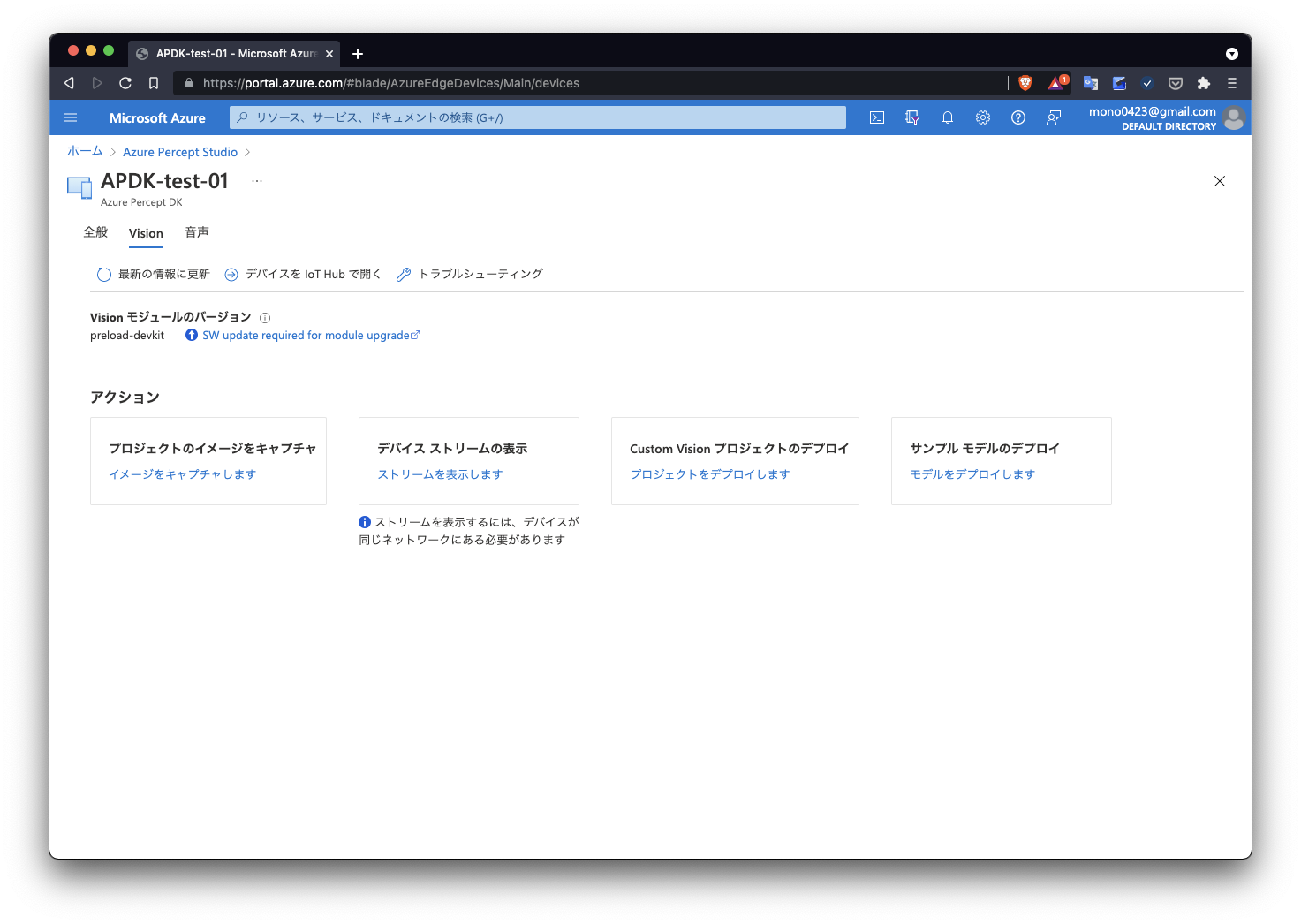

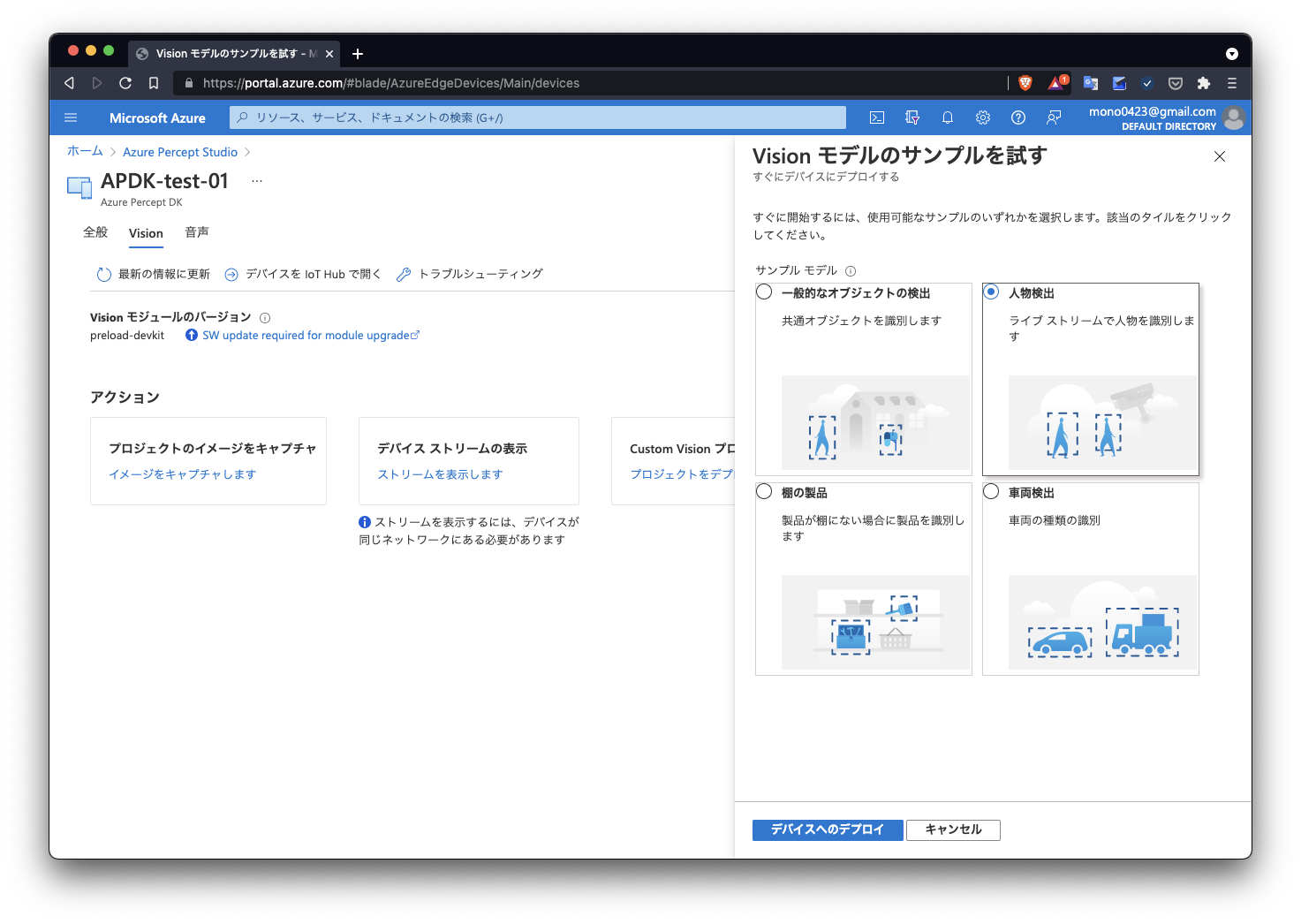

Viewsタブを開き、サンプルモデルのデプロイを選択します。

好きなモデルを選択し、デバイスへのデプロイをクリックします。

- 一般的なオブジェクトの検出

- 人やペン、車など一般的なオブジェクトの検出ができます。

- デフォルトでデプロイされているモデルはこれっぽい。

- 人物検出

- 人を検出します。

- 棚の製品

- お店の商品管理などで利用されるものと思われます。

- 車検出

- 車を検出します。

今回は人物検出を行ってみます。

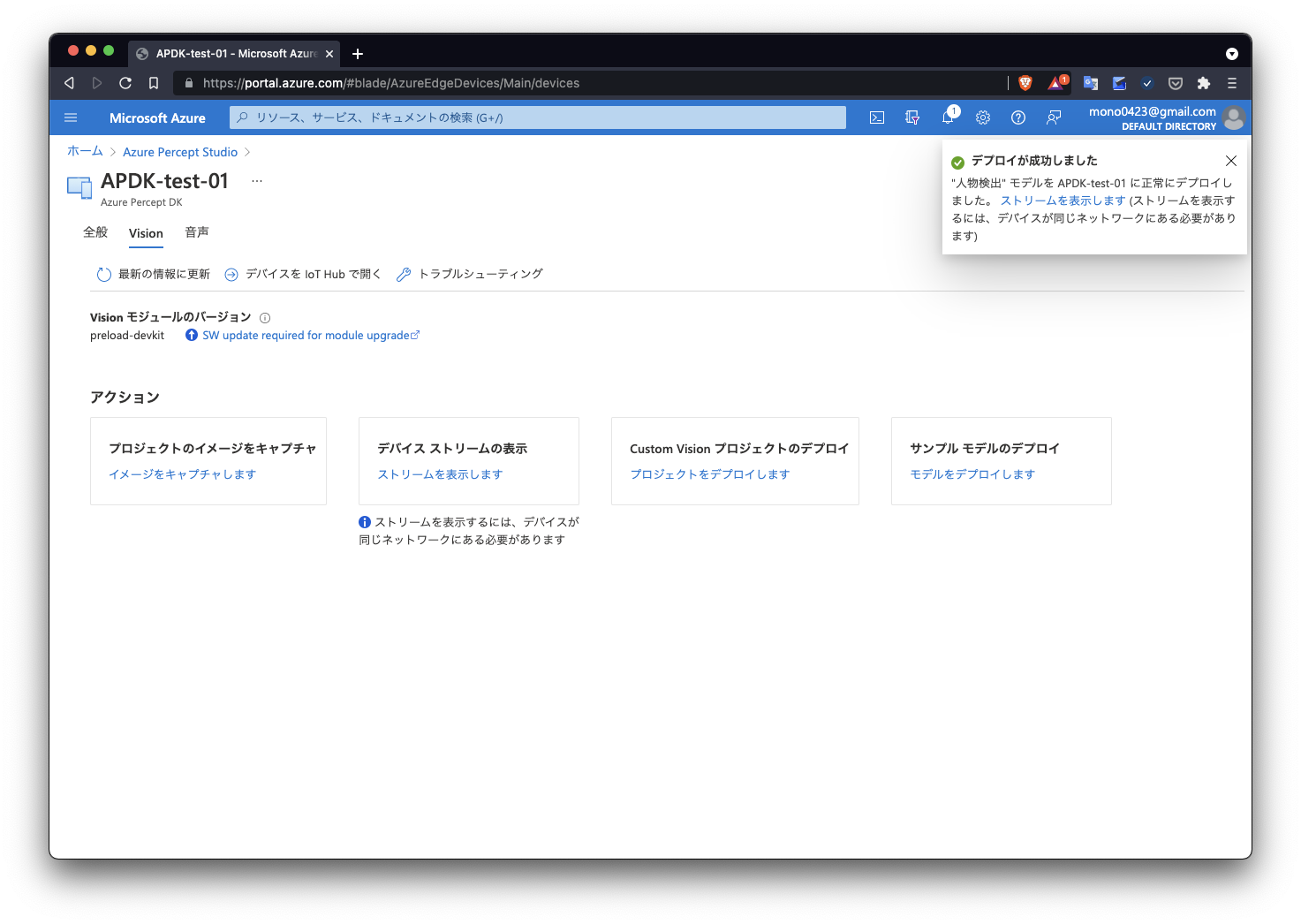

デプロイは数秒〜数十秒で完了します。

完了するとポップアップが表示されるので、ストリームを表示します。

人の検出ができました。